AIを“解剖”して科学する:

論理的に考え説明できる機械をつくる

言語推論研究室

RebelsNLU: Reading between the Lines for Natural Language Understanding

准教授:井之上 直也(INOUE Naoya)

E-mail:

[研究分野]

自然言語処理、自然言語理解、説明可能性

[キーワード]

言語モデル、深層学習、人工知能、解釈性、推論、論述理解、批判的思考力

研究を始めるのに必要な知識・能力

言葉を理解できる計算機を作りたいという熱い気持ちをもっていることが必須条件です。線形代数、確率統計、アルゴリズム、プログラミング、英語での文献調査、文章執筆スキルがあると望ましいですが、入学後でも学べます。

この研究で身につく能力

日々の研究室活動では、言葉を計算機処理するために、世界で誰も試したことのない新しいアイデアを仲間とともに磨き、これを計算機上に実装し、そのアイデアの有効性を検証していきます。面白い発見があれば、積極的に国内・国際学会に投稿し、外部の研究者とやり取りしながら、アイデアをさらに磨いていきます。こうした活動を通して、自然言語処理と周辺分野の専門知識はもちろんのこと、どこでも役立つ一生モノのスキルが身につきます。メタ思考力(常にナゼを問う意識)、仮説を立て、それを検証・整理し議論を組み立てる力、文献調査力、プログラミング力、データ分析力、といったものがその一例です。アイデアを磨く過程で、自分の考えを他者に分かりやすくプレゼンするためのコツ、チームワーク、文章執筆力も育っていきます。

【就職先企業・職種】 研究開発職、情報通信業

研究内容

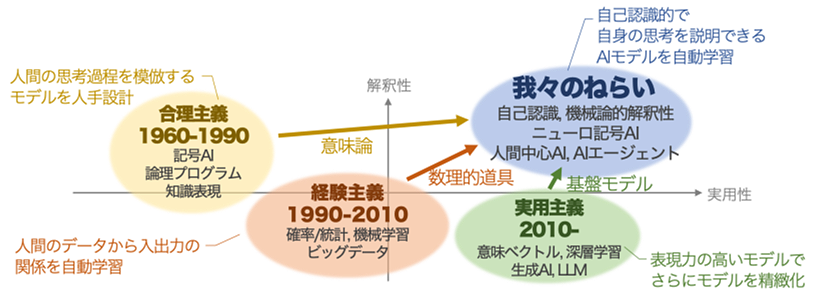

人々が日常生活で用いる言葉を計算機で処理する方法論を研究しています。特に、論理的思考能力、思考過程を説明できる能力と自己省察に基づく批判的思考能力を備えた、信頼のできる自然言語処理機構の実現を目指しています。社会に広く浸透し、高度な知的振る舞いを示す大規模言語モデル(LLM) を主な対象とし、その内部構造を分解して深く理解することで、根本的な技術課題の解決に取り組んでいます。

1. LLMの動作メカニズムの分析

LLMの内部は、人間の脳のように、多数の神経回路が相互に結びついて動作しています。計算過程そのものは最初から最後まで漏れなく追跡できますが、その背後にある計算の意味は、いまだ多くの謎に包まれています。そこで、LLMの内部構造を詳細に分析し、その知的振る舞いを支える回路、ニューロン、分散表現等を新たに発見したり、LLMの持つ知識を意図通りに効率よく操作する技術等を研究しています。代表的な成果は次のとおりです。

● LLMの動作原理の解明:LLMの文脈内学習を実現する3ステップ回路を発見 (Cho et al. ICLR2025)

● 多言語LLMの動作原理を解明:翻訳機的な役割を持つニューロンを発見 (Tezuka et al. EMNLP2025)

● LLMの記憶原理を分析して記憶を操作:言語能力を維持し有害知識を忘却 (Dang et al. AAAI2025)

● VLMの動作原理の解明:視覚言語モデルの内部表現の加法構成性を発見 (Shi et al. EACL2026)

● LLMエージェントの動作原理を解明:ユーザ指示の曖昧性に関する内部表現の分析 (貝出ら,NLP2026)

2. LLMの批判的思考力の改善

LLMはすでに高度な知的振る舞いを実現していますが、自身の考えの妥当性を評価したり、文章の背後にある論理構造を正しく理解することは、必ずしも得意ではありません。本研究室では、LLMへの指示の方法を工夫することで、自身の生成した応答の自己評価能力を向上させる新たな手法を研究しています。また、LLMの論理理解能力や、論理の弱点に切り込む質問生成能力を研究するため方法も研究しています。代表的な成果は次のとおりです。

● LLMの自己評価能力を強化:推論過程に対する精緻な自己評価を実現 (Ishii et al. ICJNLP-AACL2025)

● LLMの論理的思考力を強化:自己注意機構への介入によりLLMの論理推論能力を向上(Nguyen et al. EACL2026)

● 批判的思考支援AI の研究基盤を構築:文章の論理的誤りの理解タスク (Robbani et al. EMNLP2024)、自己内省を促す質問生成タスク (Pothong et al. ICJNLP-AACL2025)

「信頼できる・安心できるAI」を様々な観点から、特に内部構造のレベルから根本的に、徹底的に国際レベルの研究を展開します。一緒に国際的な研究室(公用語は英語です)を創り上げてくれる仲間、博士後期課程に進学しさらに研究を深く追求したい人にピッタリの研究室です!

主な研究業績

- Cho et al. Revisiting In-context Learning Inference Circuit in Large Language Models. ICLR2025.

- Tezuka et al. The Transfer Neurons Hypothesis: An Underlying Mechanism for Language Subspace Transitions in Multilingual LLMs. EMNLP2025.

- Nguyen et al. Improving Chain-of-Thought for Logical Reasoning via Attention-Aware Intervention. Findings of EACL2026.

使用装置

CPU/GPU 計算機

研究室の指導方針

本人の自主性を重んじ、自らの潜在能力を引き出せるように指導します。本人が楽しいと思える研究プロジェクトを計画立案できるよう、かつその目標に向かって自分の手で研究を進められるよう、基礎勉強会や各種週次ミーティングにより最大限支援します。国内外の学会発表や共同研究も積極的に奨励し、研究室を越えた繋がりを作ります。研究室内のコミュニケーションは基本的に英語で実施し、“ 現場ですぐに使える” 英語を身に付けてもらい、国際的に活躍できる人材を育てます。

[研究室HP] URL:https://rebelsnlu.super.site/