テキストから正確な建築デザインを自動で生成するAIシステムを開発 ―多段階拡散モデルによる新しい建築設計手法―

|

北陸先端科学技術大学院大学 早稲田大学 |

テキストから正確な建築デザインを自動で生成するAIシステムを開発

―多段階拡散モデルによる新しい建築設計手法―

ポイント

- テキスト入力だけで、階数や窓配置などの構造を正確に反映した建築デザイン画像を生成できるように、多段階生成および検索拡張生成(RAG)を組み合わせたAI技術を開発

- 建築構造制御・建築要素合成・建築画像生成を順に行う3段階の生成フレームワークにより、既存モデルを大幅に上回る精度を実現

- 大規模な3Dモデリング作業を必要とせず、設計初期段階で迅速に建築イメージを可視化でき、建築設計プロセスの効率化に貢献

| 北陸先端科学技術大学院大学 創造社会デザイン研究領域の謝 浩然准教授(早稲田大学 理工学術院総合研究所 主任研究員)らの研究グループと、天津大学建築学院の張燁准教授らの研究グループは、テキストによる記述から正確な建築の外観(ファサード)画像を自動生成する新しい生成AIシステムを開発しました。 従来の生成AIでは、「5階建て」などの数値情報を正確に反映することが難しく、階数の誤りや窓配置のずれといった構造的な不正確さが大きな課題となっていました。今回提案したシステムは、建築データセットから検索して得られる情報を生成プロセスに組み込む仕組みを採用することで、既存モデルを大幅に上回る精度を実現しました。このシステムにより、設計初期段階において建物イメージを迅速かつ正確に可視化でき、建築設計プロセスの効率化への貢献が期待されます。 なお、本研究成果は、建築デザイン分野の国際学術誌「Frontiers of Architectural Research」(Elsevier発行)に掲載され、2026年3月26日にオンライン版で公開されました。 |

【研究の背景】

建築家はプロジェクトを進める中で、ラフなコンセプトをビジュアル表現として素早く具体化し、クライアントや設計チームと共有する必要があります。しかし、高品質な建築ビジュアライゼーションには高度な専門知識と高価なソフトウェアが不可欠であり、特に設計初期段階における迅速な反復作業の妨げとなっていました。近年、テキストから画像を生成する生成AIモデルが建築分野においても注目されており、テキストによる説明を入力するだけで高品質なデザイン画像を生成できる可能性が広がっています。

しかし、これらのモデルはテキスト入力の内容を正確に反映した画像を生成できないケースが多く、例えば「5階建ての建物を生成せよ」という直接的な指示に対しても、異なる階数の建物が生成されてしまうことがあります。この原因は、学習データセットにおける建物構造の詳細なアノテーションの不足にあると考えられます。さらに、建築設計が本来、全体構成の決定から要素配置に至るまで複数の段階的プロセスを含むにもかかわらず、従来の手法ではこれらを単一のモデルで一括して扱っている点も重要な要因であると考えられます。そのため、AIが階数や窓・ファサード要素の正確な配置といった数値的・空間的な要件を理解することが難しく、建築設計の実務への適用を大きく制限しています。そこで、本研究はデザイナー(建築家)による設計ワークフローを考慮して多段階生成のフレームワークを提案しました。

【研究の内容】

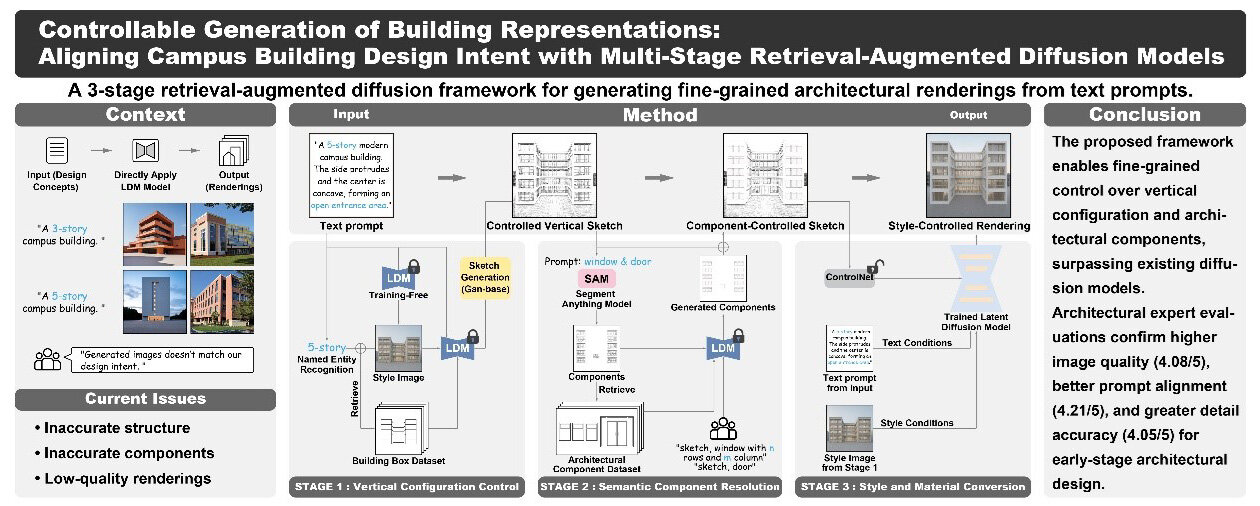

本研究では、これらの課題に対し、建築設計プロセスに対応した3段階生成フレームワークを提案しました。提案システムは、各生成段階において外部の建築データベースを動的に参照する仕組み「検索拡張生成(RAG)」を組み込むことで、AIが既存の建築例を手がかりとして画像を生成できる仕組みを実現しています。本フレームワークでは、テキストによる建物の説明を以下の3段階を通じて段階的にリアルな建築画像へと変換します(図1)。

図1.検索拡張生成(RAG)を用いた生成AIによる建築設計システム

まず第1段階では、テキストプロンプトをもとに、建物の全体形状と正確な階数を反映した構造スケッチを生成します。次に第2段階では、実際の建築部品データセットを参照しながら、窓やドアといった詳細な建築要素を追加してスケッチを精緻化します。最後に第3段階では、精緻化されたスケッチと元のテキスト記述を組み合わせることで、設計者の意図を忠実に反映した高品質な建築レンダリング画像を生成します。

| 段階 | プロセス | 内容 |

| 第1段階 | 建築構造制御 | テキストプロンプトをもとに、建物全体の形状と正確な階数を捉えた構造スケッチを生成 |

| 第2段階 | 建築要素合成 | 実際の建物要素のデータセットを参照し、窓・ドアなどの詳細な建築要素を追加してスケッチを精緻化 |

| 第3段階 | 建築画像生成 | 精緻化されたスケッチと元のテキスト記述を組み合わせ、設計者の意図を正確に反映した高品質なレンダリング画像を生成 |

提案の多段階生成フレームワークは、建築家が全体的な形状から窓・ドア・ファサード要素へと順に設計を深めていく実際の設計ワークフローを模倣したものであり、AIによる建築設計の自動化に向けた基盤となりうるものであると考えられます。

【研究の成果】

本研究は、大学キャンパスの建物のデザインを対象に提案フレームワークの有効性を検証しました。キャンパス建築は階数の制御や窓・入口の配置が特に重要であり、提案手法の評価対象として適切です。検証実験のために、3種類の専用データセットを新たに構築しました。具体的には、建物ボックスデータセット(2,200枚)、多様な窓・ドアの配置を示す建築要素データセット(4,000枚)、および詳細スケッチ・テキストプロンプト・最終レンダリング画像を対応付けたペアデータセット(1,600組)です。

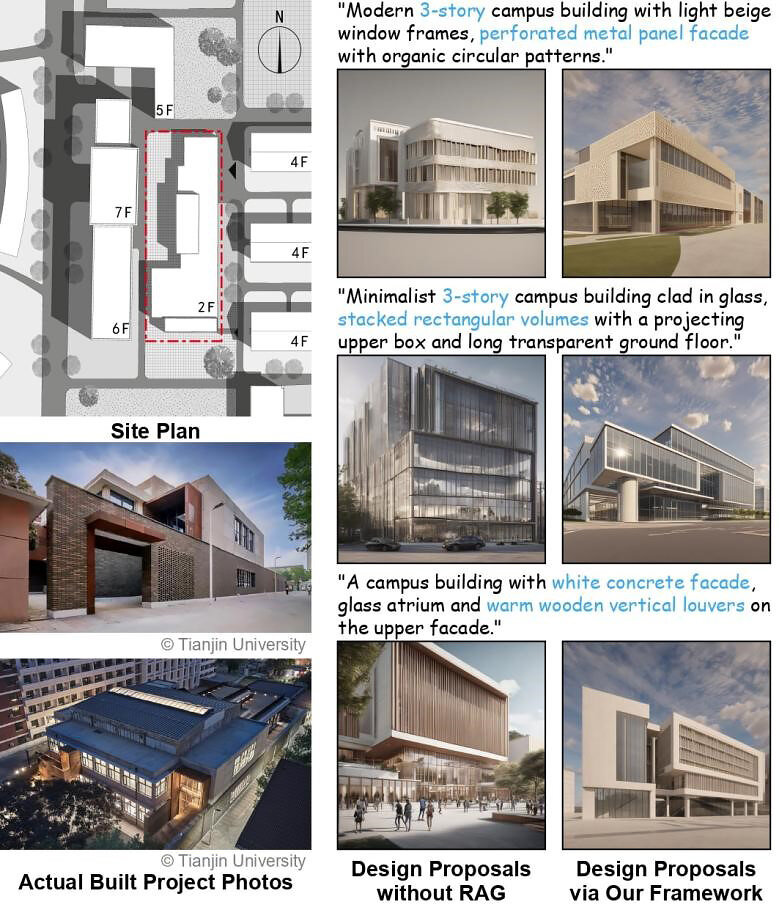

客観評価の実験では、提案フレームワークは建築構造の制御精度(階数)において70.5%を達成し、同一評価指標において、PixArt-α(34.1%)、HunyuanDiT(31.8%)、Stable Diffusion 1.5(29.7%)といった最先端生成AIモデルを大幅に上回りました。また、構造的正確さ・視覚的リアリティ・生成画像とテキストプロンプトの整合性を測定する複数の品質指標(PSNR、SSIM、LPIPS、FID、CLIP)においても、比較対象とした前述の生成AIモデルを上回る結果を示しました。さらに、建築・デザイン専攻の大学院生56名を対象とした主観評価においても、画像品質・プロンプト整合性・建築詳細の正確さのいずれの項目においても5段階評価で平均4点以上の高評価を得ました。加えて、提案フレームワークを実際のキャンパス建築設計プロジェクトに適用し、その実用的な有効性を確認しました(図2)。

| 図2.提案システムによるよりリアルなキャンパス建築デザインの生成例。左列は天津大学が提供した実際の敷地計画図および竣工建物の写真(許可を得て転載)。中列は検索拡張アプローチを使用しない標準的なAIモデルが生成したファサードデザイン、右列は本フレームワークが生成したデザインを示します。両者を比較すると、本フレームワークが実際のキャンパス環境のスタイルと制約条件をより適切に反映した建物デザインを生成でき、建築家が実際に建てようとするものにより近い結果を出力できることが明らかです。 |

【研究の意義と今後の展望】

本研究は、建築設計の初期段階におけるワークフローを効率化する可能性を持ちます。設計者は打ち合わせ中にクライアントのフィードバックをリアルタイムに反映しながらスキームを素早く修正でき、設計の反復サイクルを大幅に短縮することが期待されます。また、計画担当者やデベロッパーは、詳細なモデリング作業を開始する前に、与えられた制約条件のもとで複数の設計代替案を迅速に可視化・比較検討することが可能となります。これにより、早期段階における意思決定の質と効率が向上すると考えられます。

今後の展望としては、現在はキャンパス建物のファサードと窓・ドアの制御に限定されている提案フレームワークを、住宅や商業施設など他の建物タイプへと拡張することが挙げられます。さらに、バルコニーや屋根形状といった追加的な建築要素への対応、およびBIM(ビルディング・インフォメーション・モデリング)ツールとの連携による下流の設計ワークフローへの統合も重要な課題です。生成AIの継続的な進化とともに、本研究のような取り組みが建築ビジュアライゼーションをより迅速かつ広くアクセス可能で信頼性の高いものへと変革していく上で、重要な基盤となることが期待されます。

【研究支援】

本研究は、以下の研究資金の支援を受けて実施されました。

科学技術振興機構(JST)国家戦略分野の若手研究者及び博士後期課程学生の育成事業(BOOST) 次世代AI人材育成プログラム(若手研究者支援)(課題番号:JPMJBY24D6)

中国国家自然科学基金(課題番号:52508023)

【論文情報】

| 掲載誌 | Frontiers of Architectural Research |

| 論文題目 | Controllable Generation of Building Representations: Aligning Campus Building Design Intent with Multi-Stage Retrieval-Augmented Diffusion Models |

| 著者 | Zhengyang Wang, Yuxiao Ren, Hao Jin, Jieli Feng, Xusheng Du, Ye Zhang*, Haoran Xie* |

| DOI | 10.1016/j.foar.2026.01.018 |

| 掲載日 | 2026年3月26日にオンライン版に掲載 |

令和8年3月31日